共计 1609 个字符,预计需要花费 5 分钟才能阅读完成。

整个过程需要准备三个软件:

- Ollama。用于运行本地大模型。如果使用闭源大模型的 API,则不需要安装 Ollama。

- Docker。用于运行 AnythingLLM。

- AnythingLLM。知识库运行平台,提供知识库构建及运行的功能。

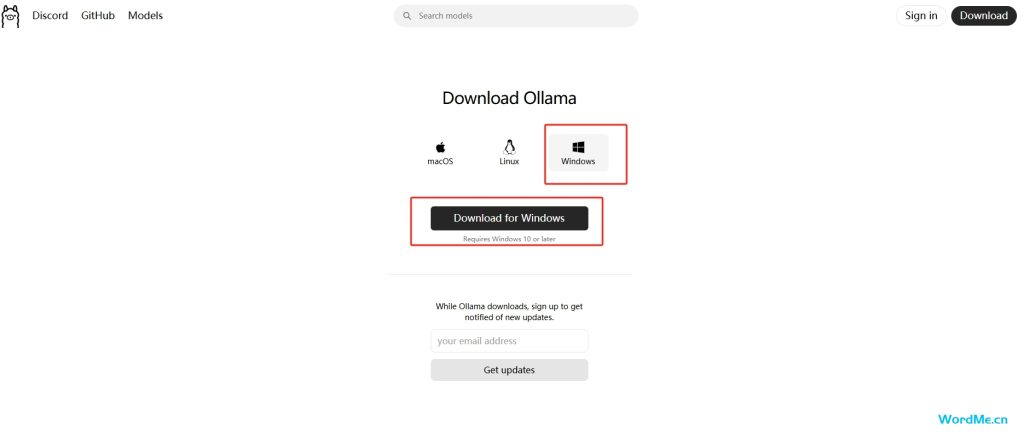

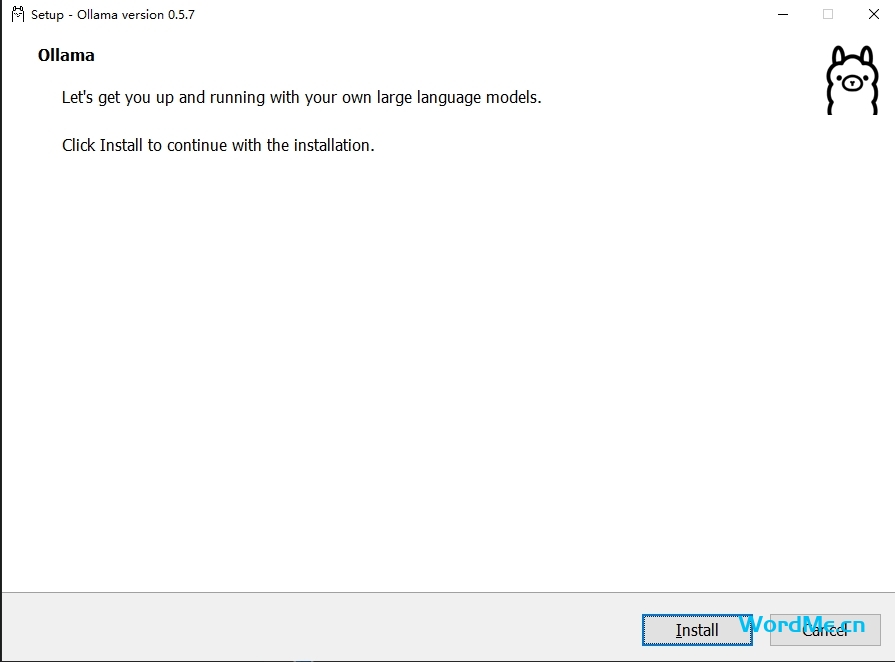

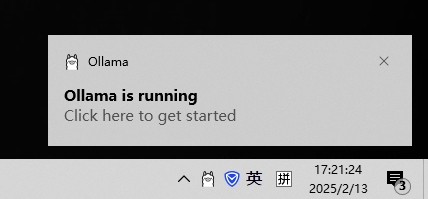

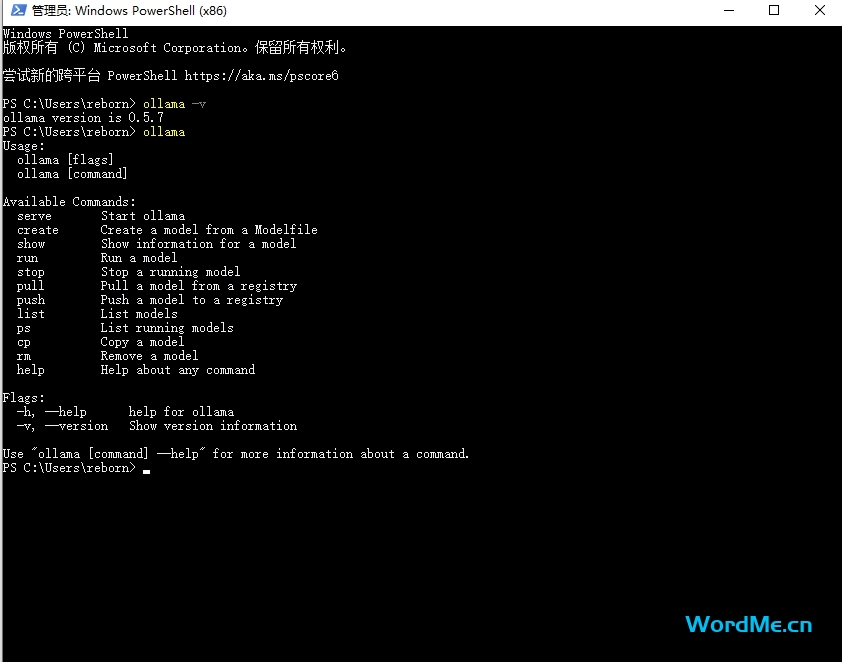

一、安装 Ollama

- 下载地址:点我进入

下载后直接安装。

- 至此,Ollama 安装完毕。

二、安装 Docker

Docker 是一个开源的应用容器引擎,让开发者可以打包他们的应用以及依赖包到一个可移植的镜像中,然后发布到任何流行的操作系统的机器上,从而实现虚拟化。

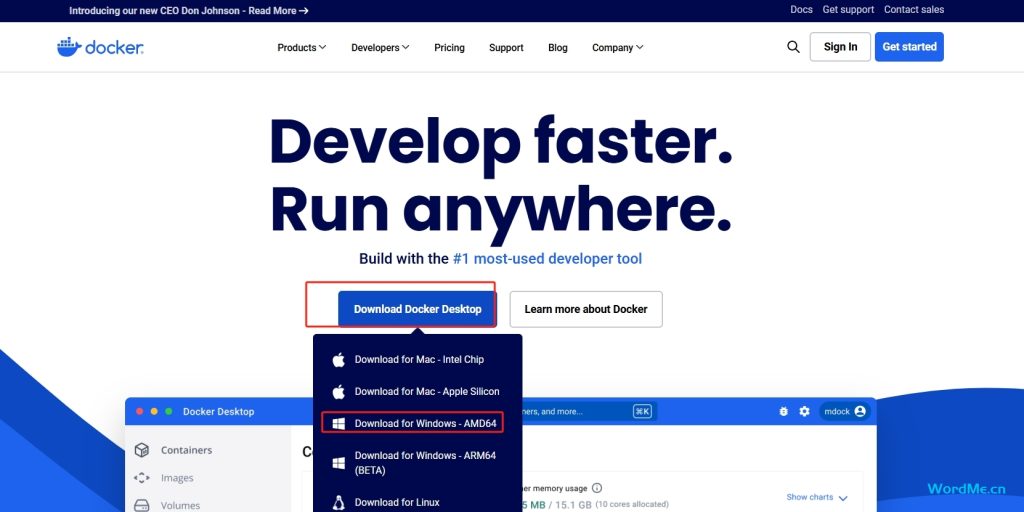

- 下载安装 Docker Desktop(下载网址:https://www.docker.com/products/docker-desktop/)

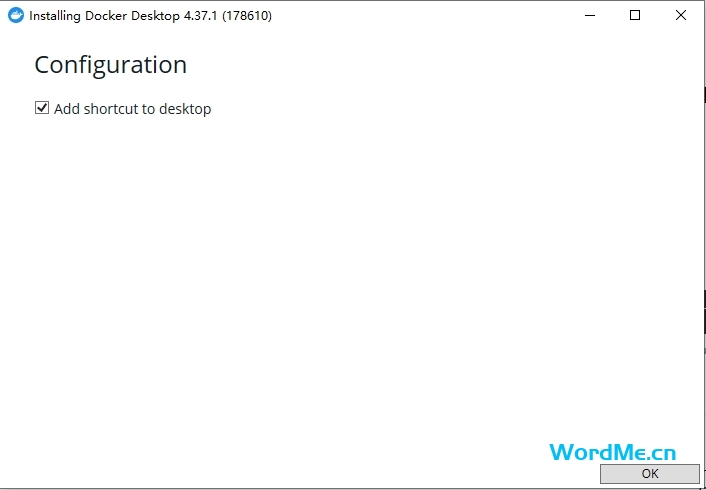

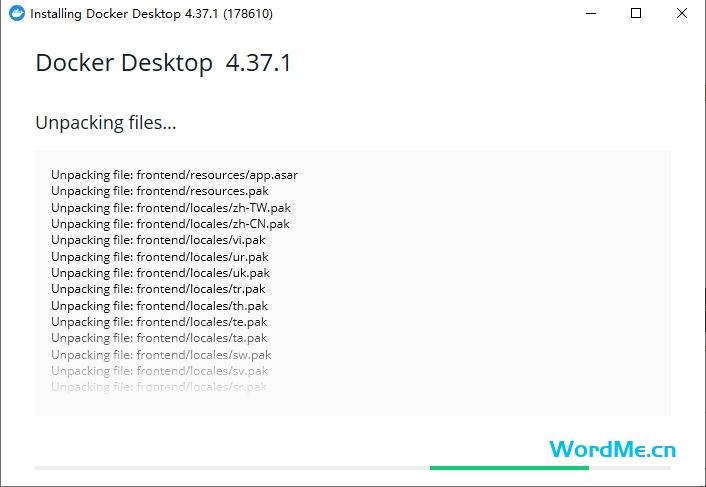

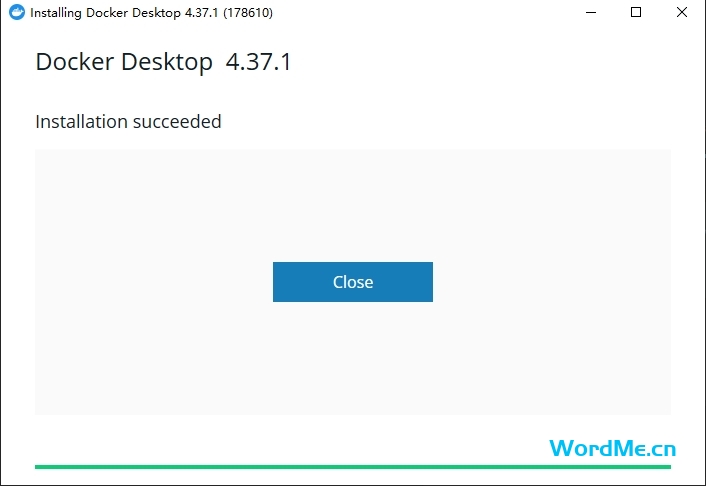

- 下载后直接双击安装即可,Docker 的安装过程非常简单,没有什么参数需要设置,一路 next 即可。

- 启动 Docker Desktop。第一次启动可能需要注册账号、设置角色等,可以暂时跳过。

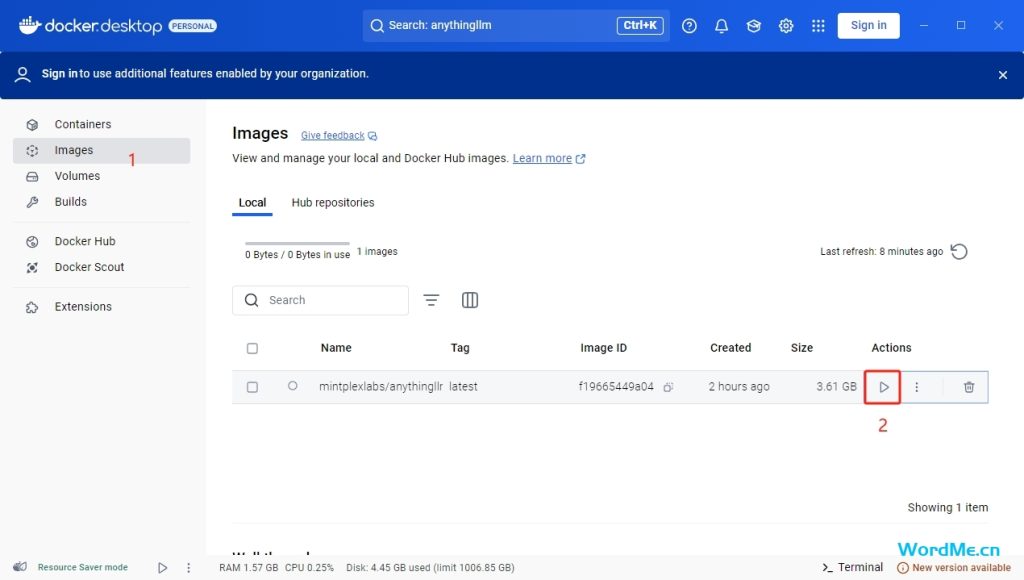

三、Docker 安装 AnythingLLM

AnythingLLM 可以在 Docker 上安装。

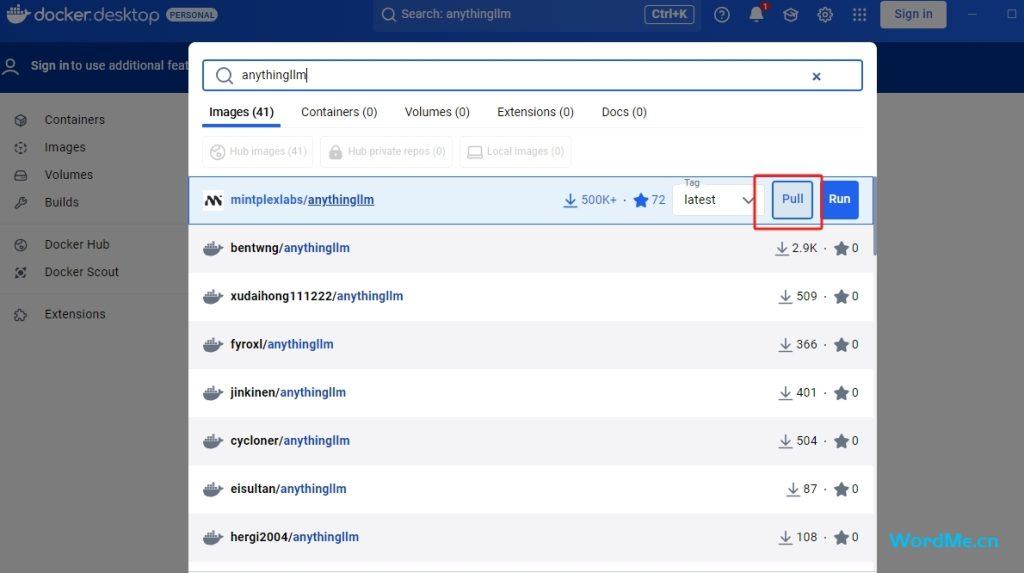

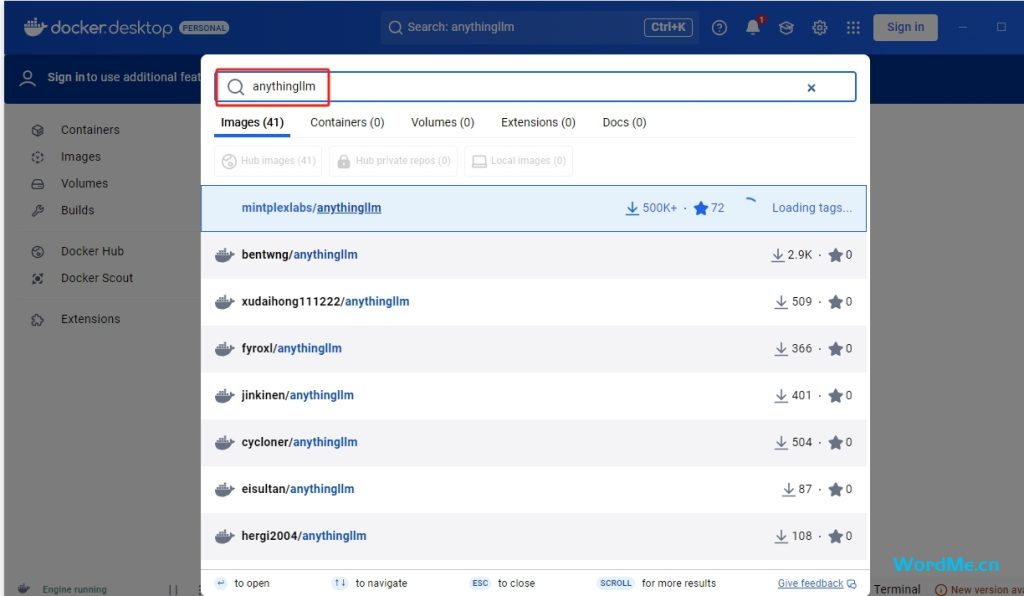

- 点击顶部的搜索框或输入快捷键

Ctrl + K打开搜索窗口,输入anythingllm进行搜索,如下图所示,点击 Pull 按钮拉取镜像

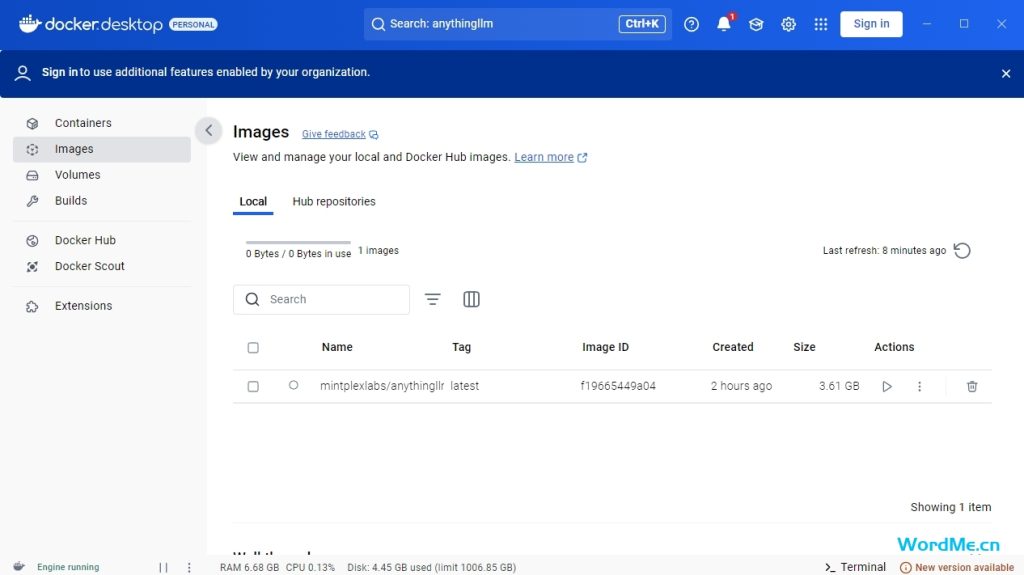

- 镜像拉取完成

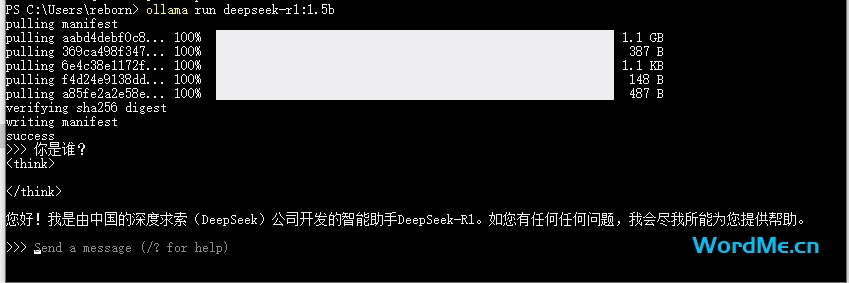

四、Ollama 安装 DeepSeek

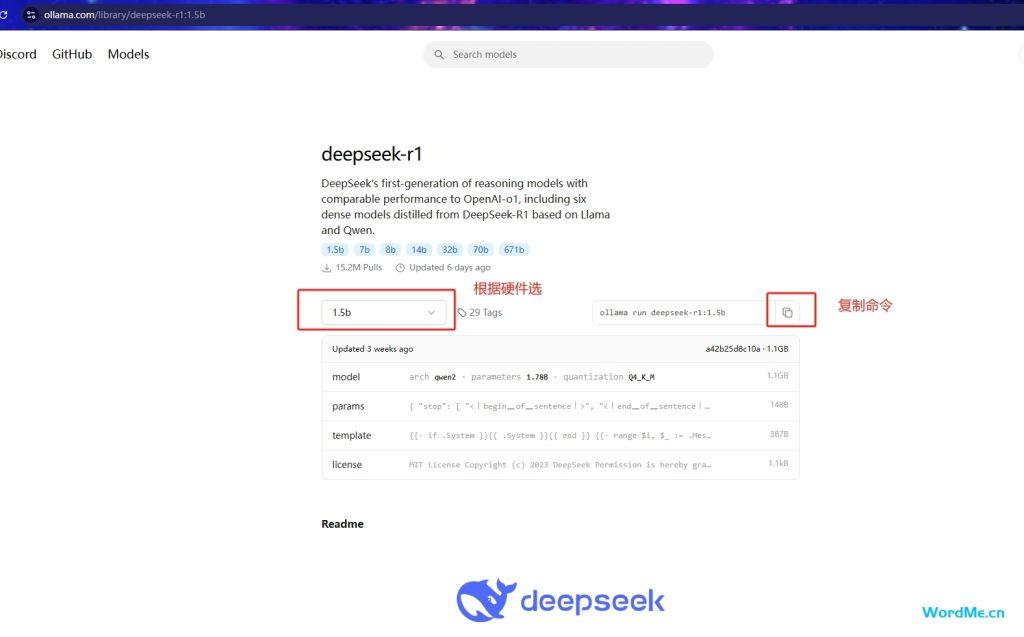

- 进入 Ollama 复制安装 deepseek 命令或者复制以下命令

ollama run deepseek-r1:1.5b

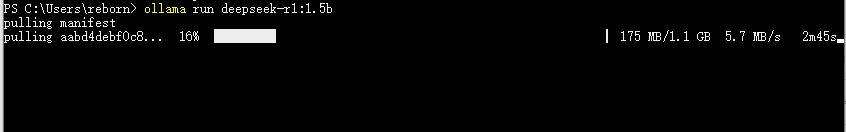

- 打开 cmd,输入命令安装 deepseek

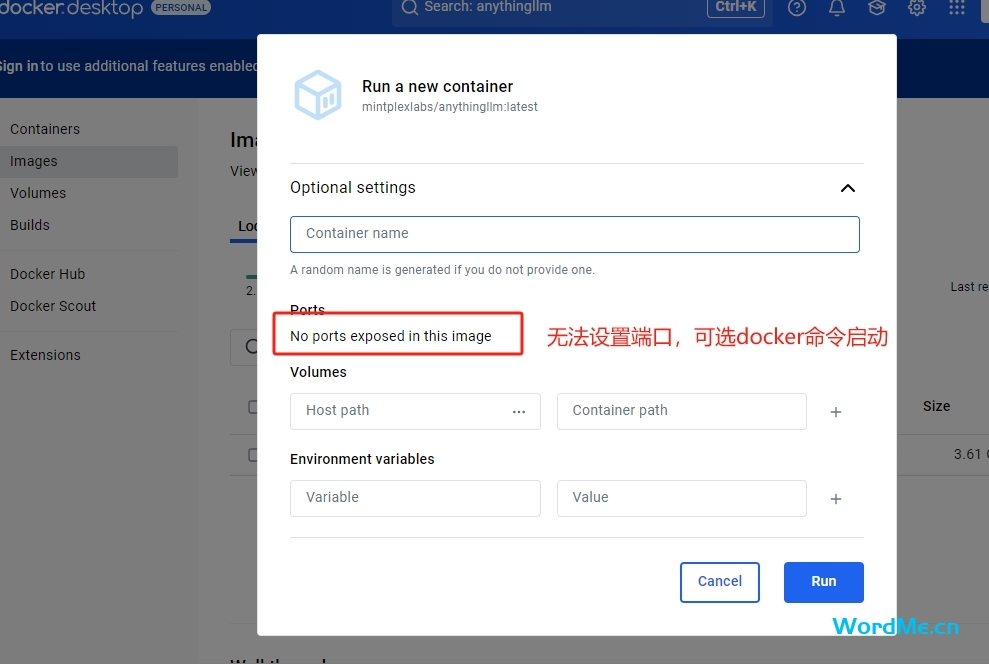

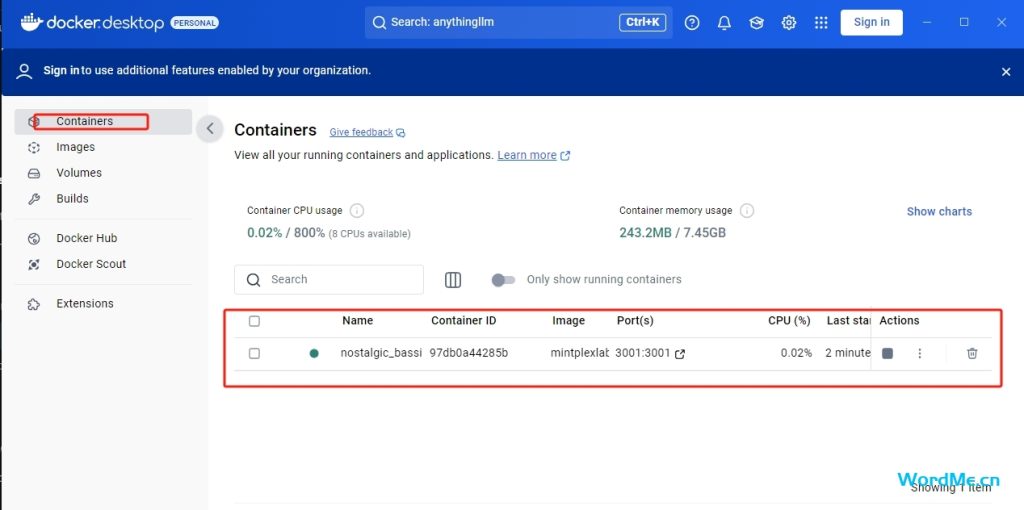

五、启动 AnythingLLM 容器

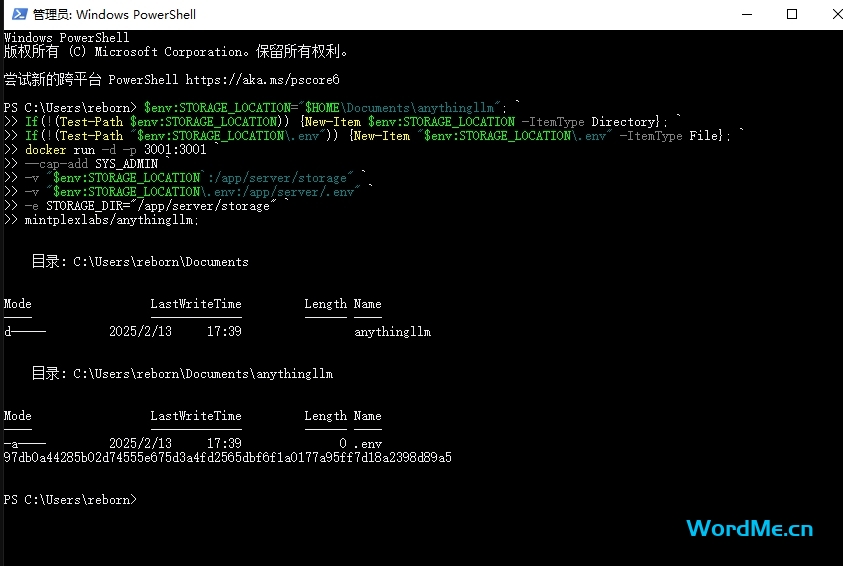

- 可选操作 docker 界面启动或者运行 cmd,输入命令启动

- cmd 输入 docker 命令启动

$env:STORAGE_LOCATION="$HOME\Documents\anythingllm"; `

If(!(Test-Path $env:STORAGE_LOCATION)) {New-Item $env:STORAGE_LOCATION -ItemType Directory}; `

If(!(Test-Path "$env:STORAGE_LOCATION\.env")) {New-Item "$env:STORAGE_LOCATION\.env" -ItemType File}; `

docker run -d -p 3001:3001 `

--cap-add SYS_ADMIN `

-v "$env:STORAGE_LOCATION`:/app/server/storage" `

-v "$env:STORAGE_LOCATION\.env:/app/server/.env" `

-e STORAGE_DIR="/app/server/storage" `

mintplexlabs/anythingllm;

- 启动

anythingllm容器成功

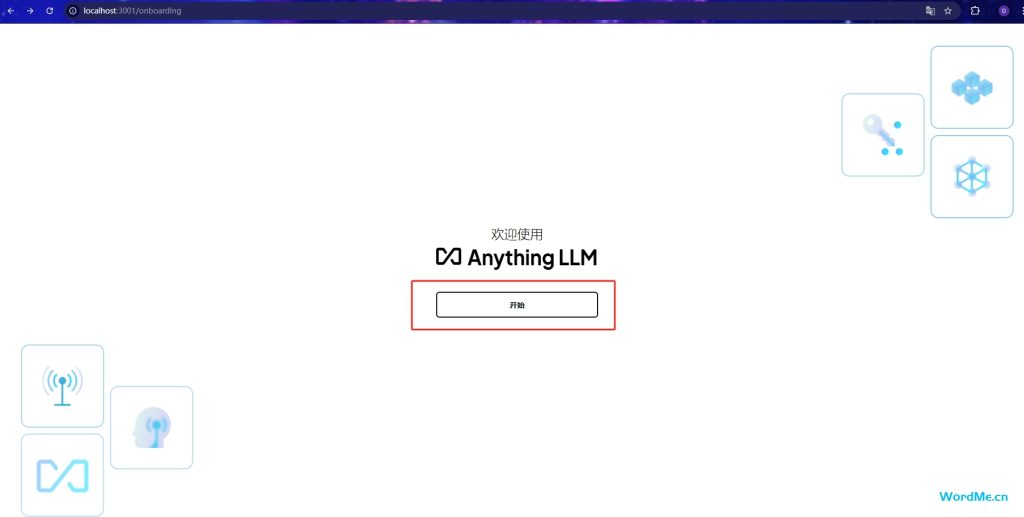

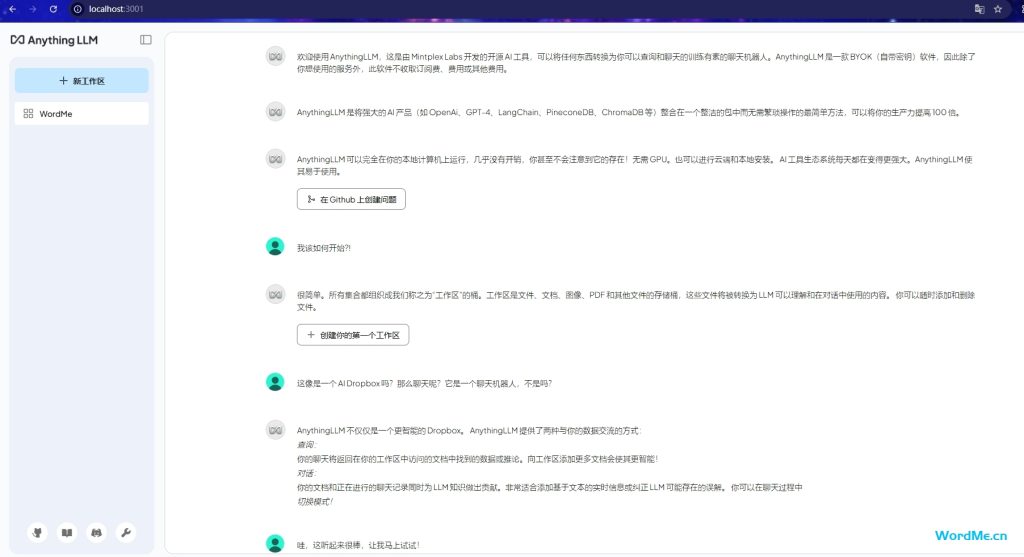

六、访问并配置AnythingLLM

- 浏览器输入地址:http://localhost:3001

- 点击按钮 开始 进入设置向导界面

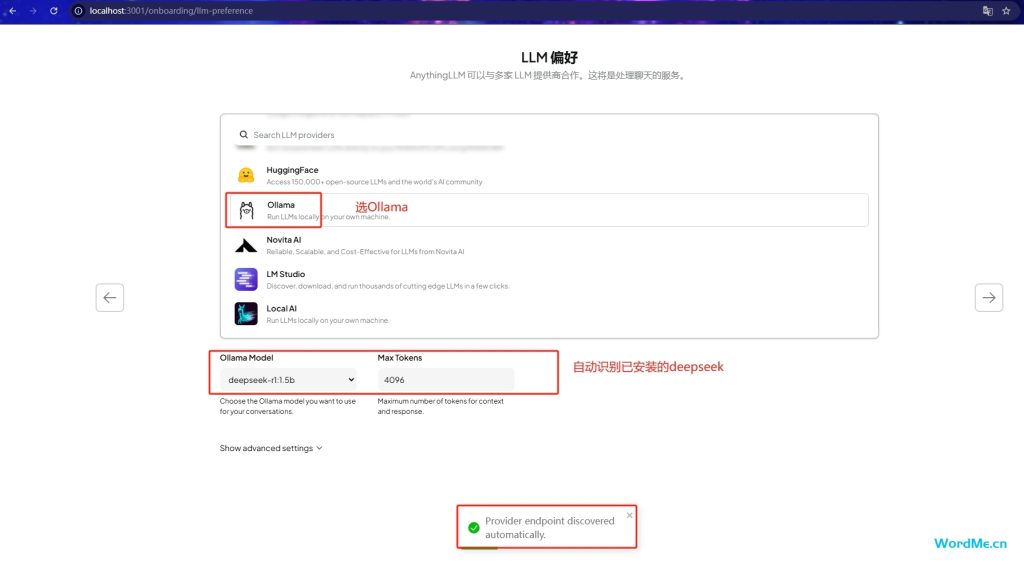

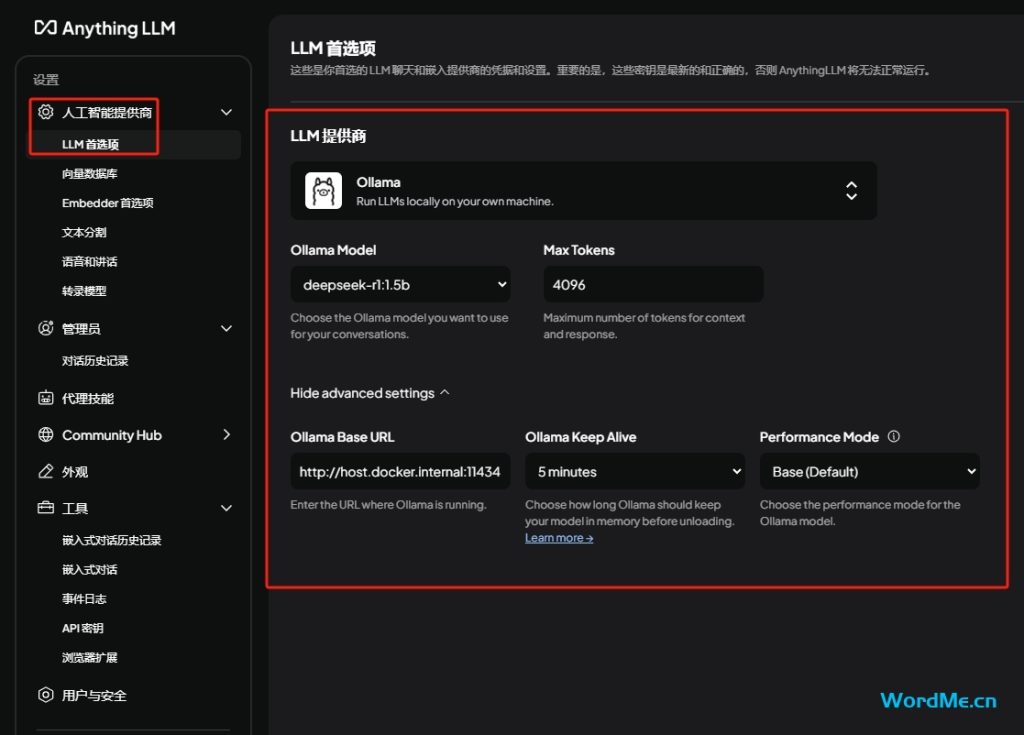

- 选择大模型。如下图所示设置使用

Ollama,然后设置识别到的 deepseek; - 如没有自动识别功能的旧版本可如下设置:

- 指定

Ollama Base URL为 http://host.docker.internal:11434 - 指定

Chat Model Selection为 qwen:14b - 指定

Token context window为 4096

- 指定

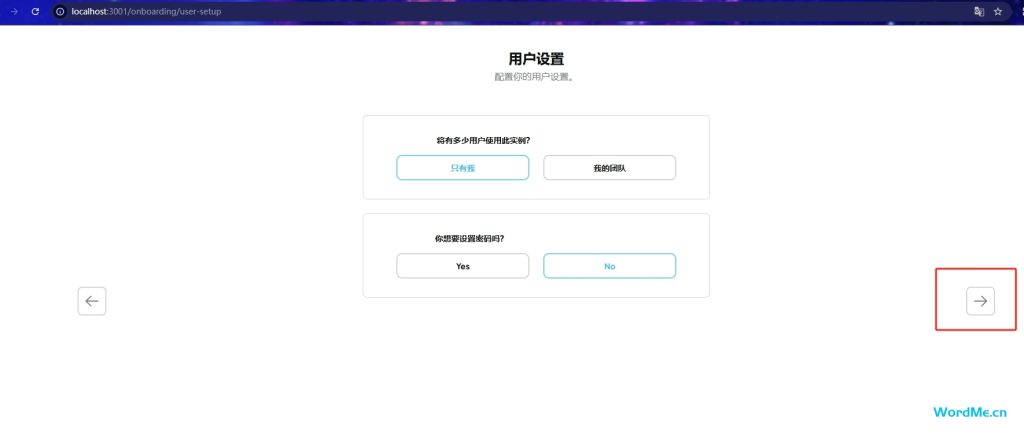

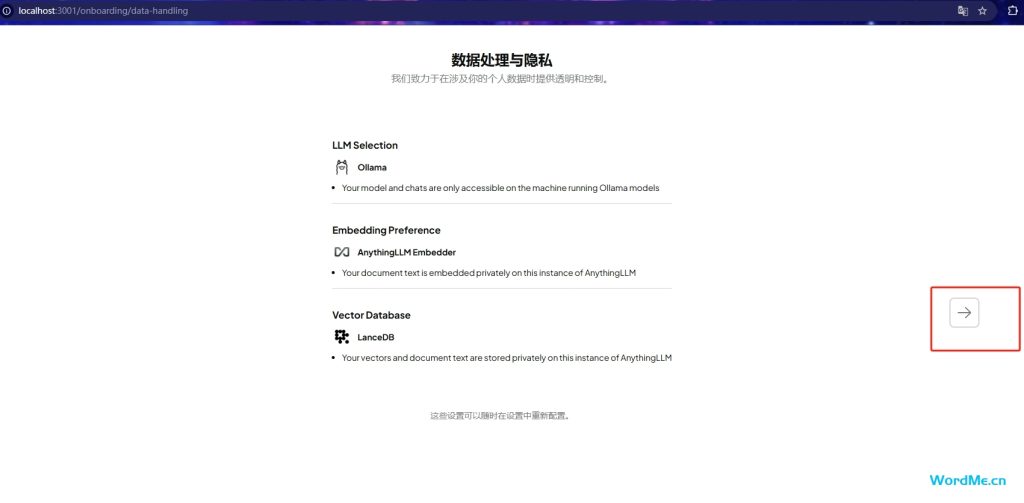

- 一路 next

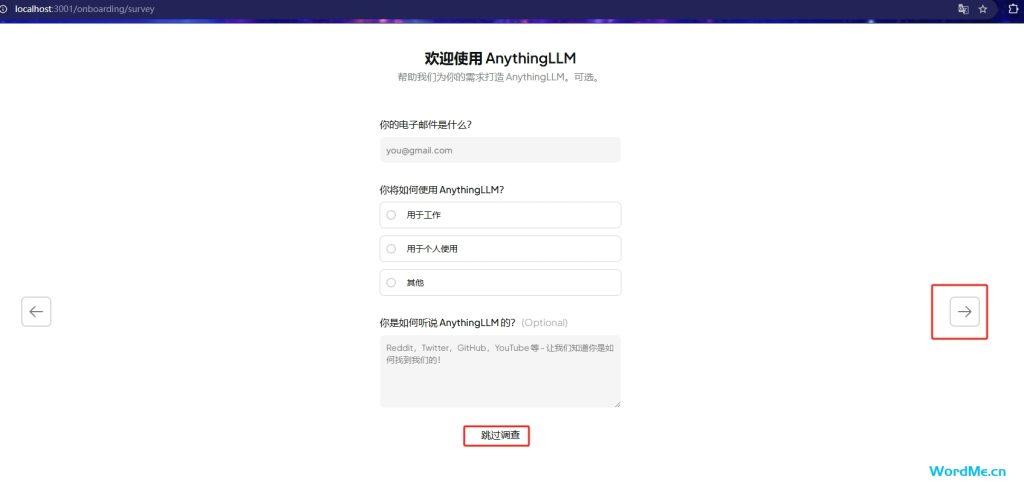

- 根据使用情况设置团队信息

- 此处可选默认的

AnythingLLM Embedder或者跳过

- 可自由设置或者选择跳过

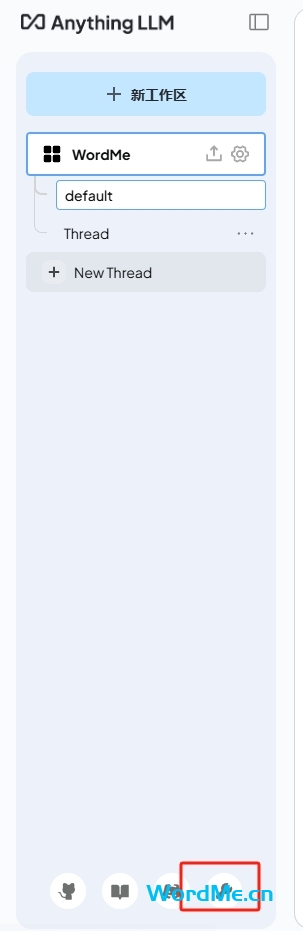

- 自由设置工作区名称

- 完成基本设置,进入下一步

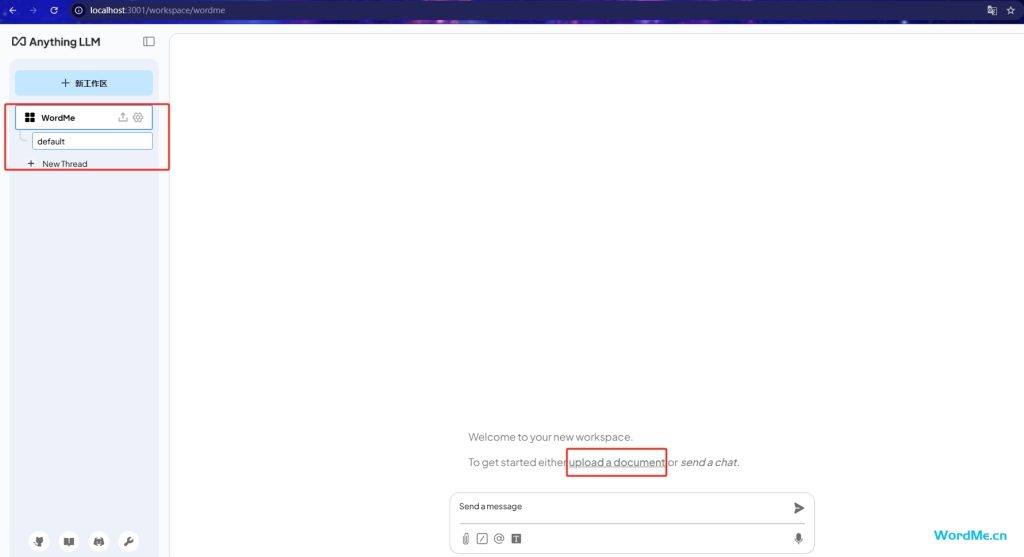

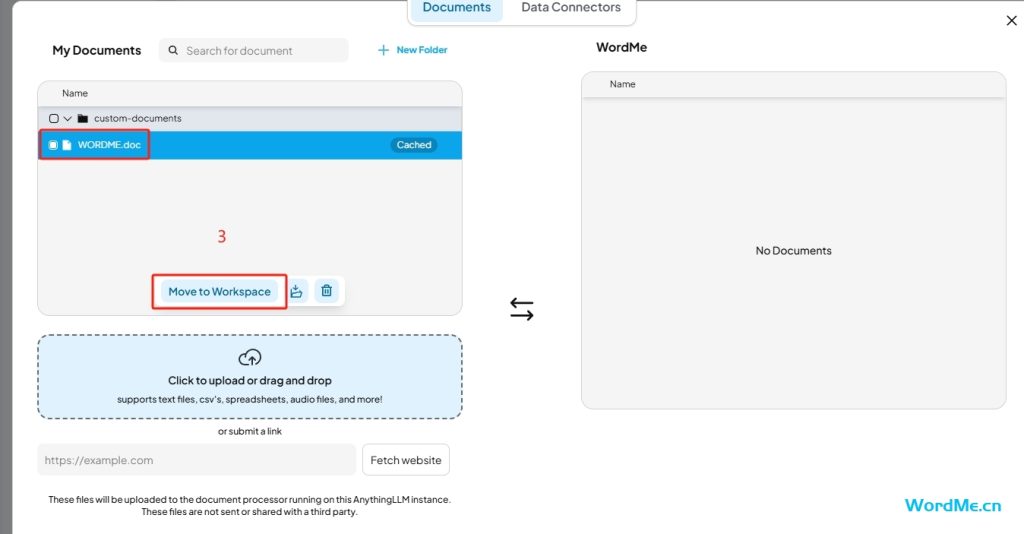

- 如下图所示,点击链接

upload a document打开文档上传界面

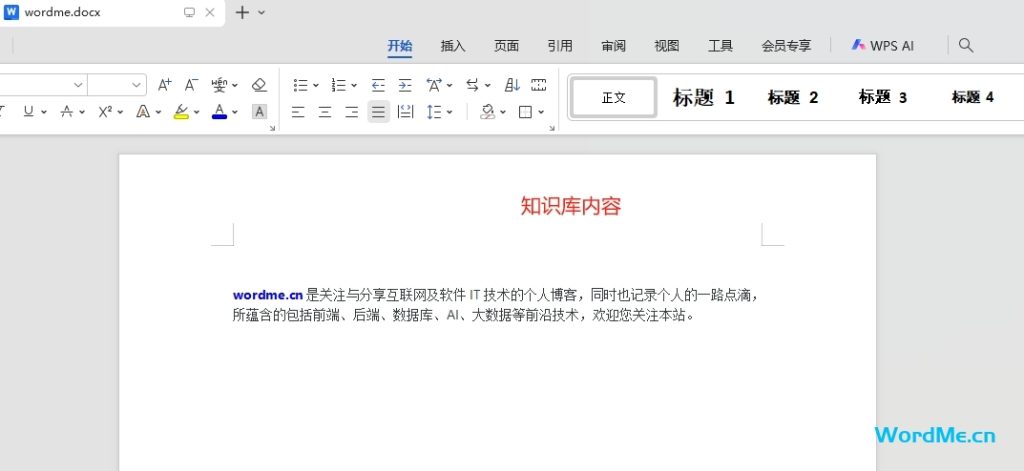

- 可以添加自己的文档,并将文档移入工作区

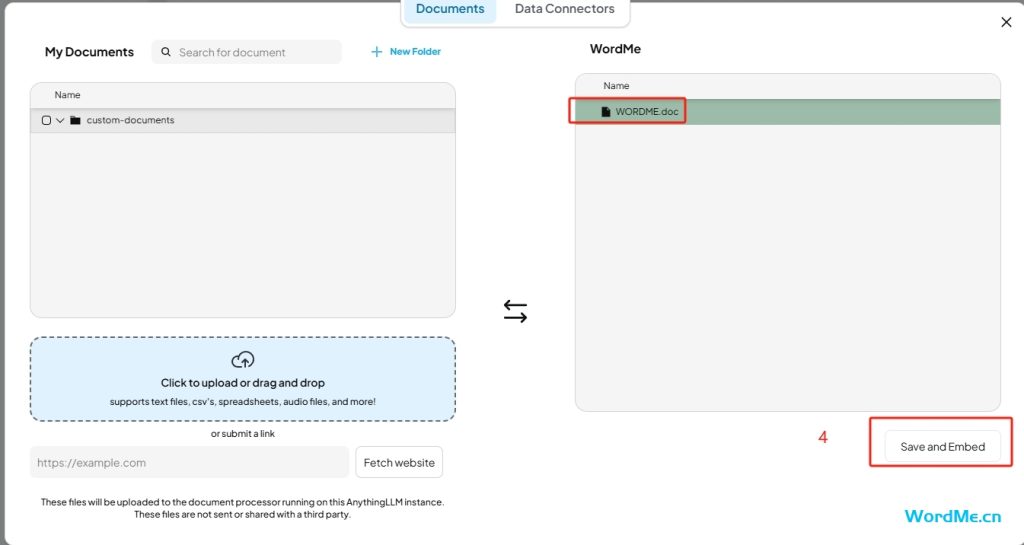

- 文档移入后如下图所示

- 点击按钮 Save and Embed 处理文档

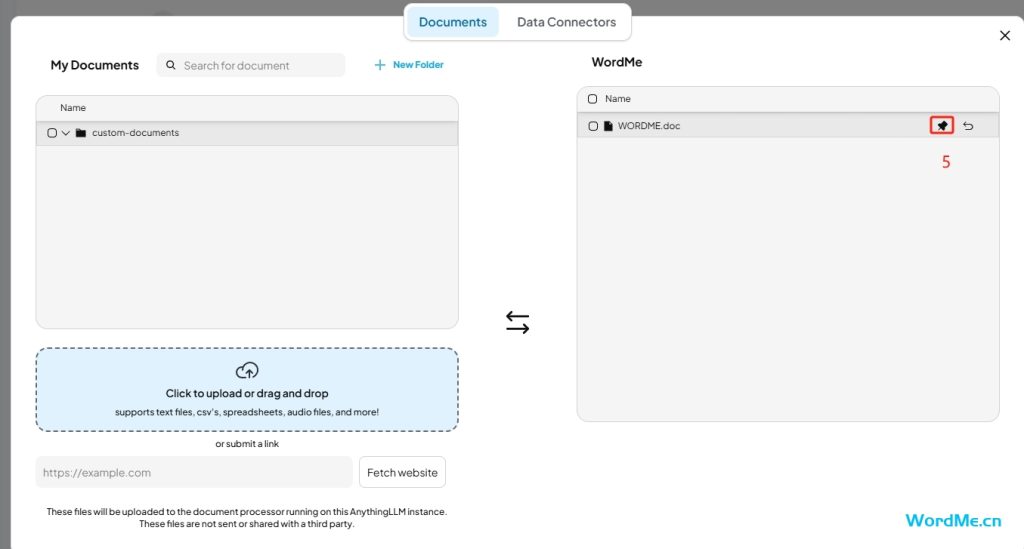

- 可选 钉 住文档

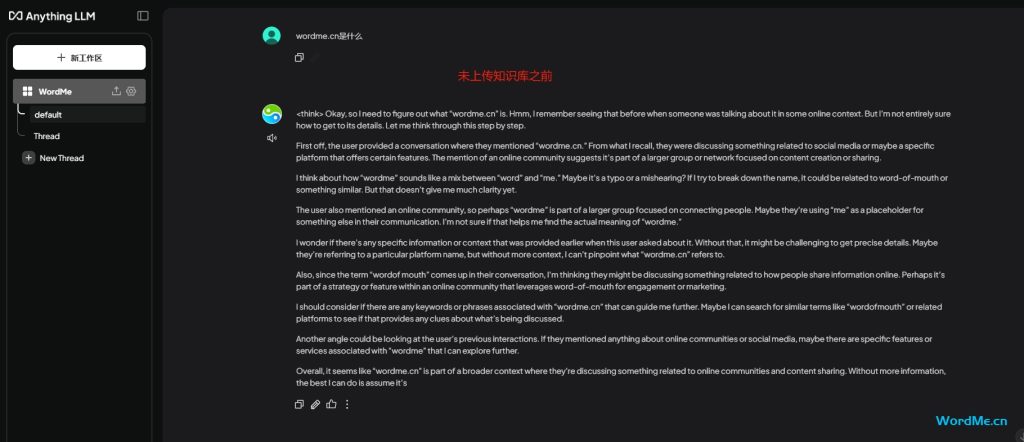

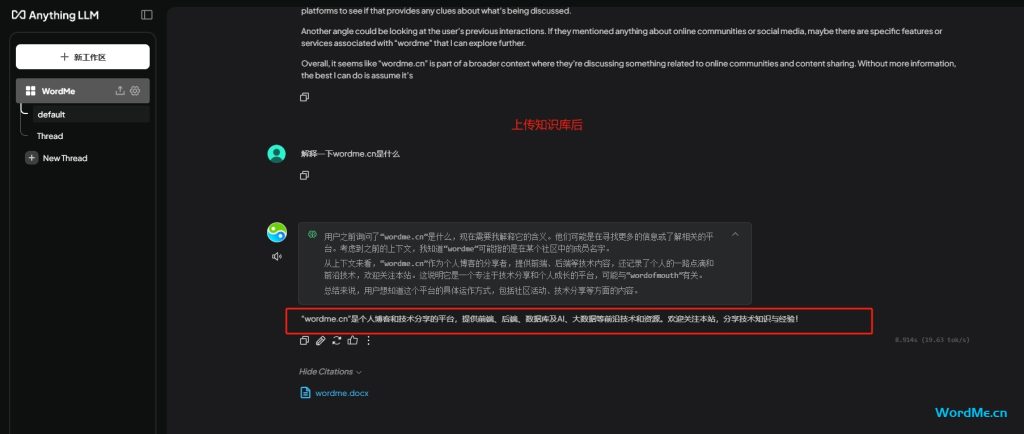

- 文档处理完毕后可以进行测试,如下图所示

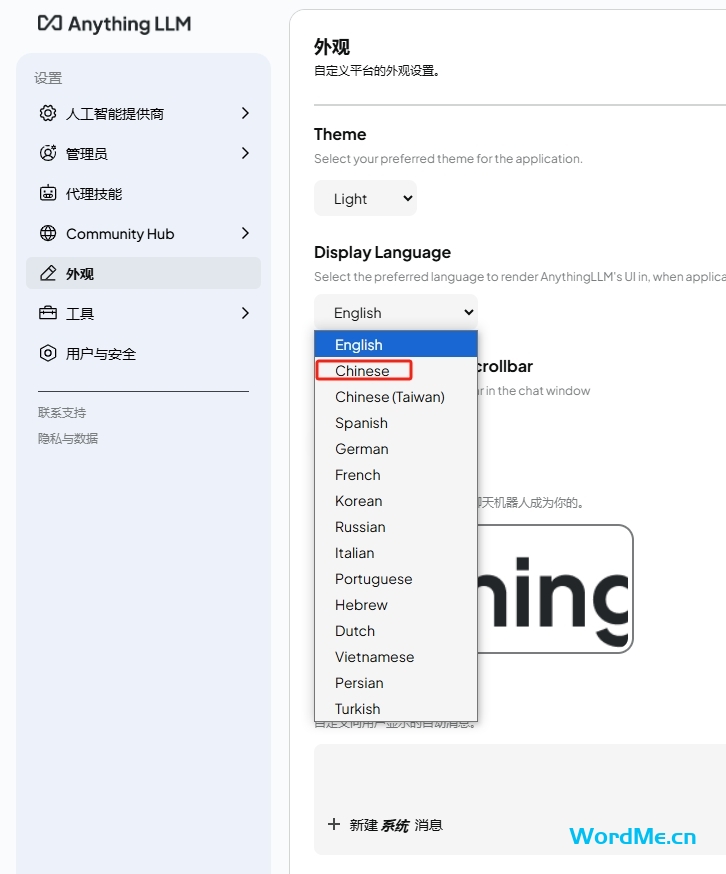

- 其他可选配置

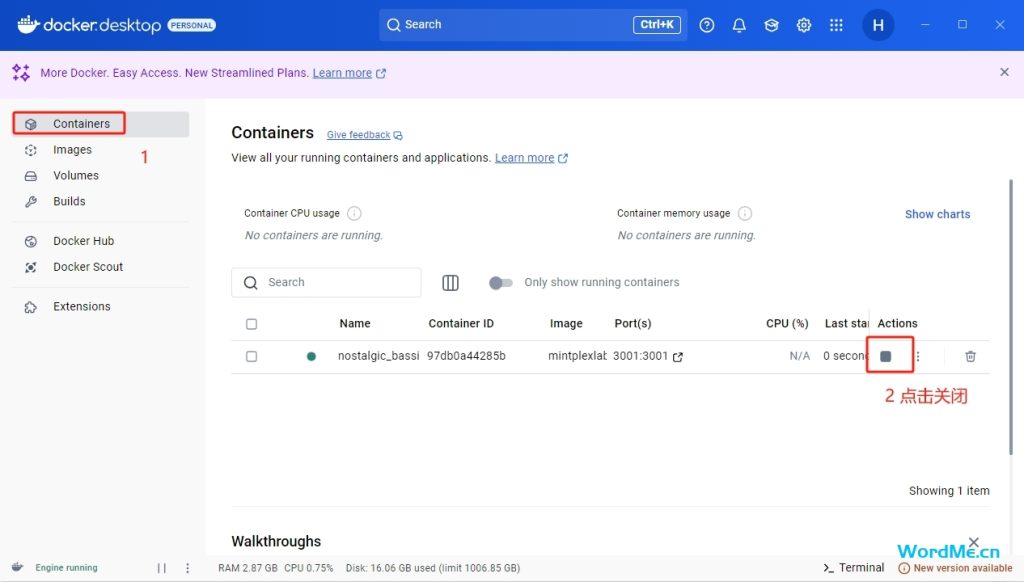

七、关闭 Docker

当不使用大模型时,为了节省资源,可以选择关闭容器。

- 点击 Containers ,点击关闭按钮可以关闭容器

正文完